MRM/McCann programmiert Signs für Menschen mit Hörbehinderung:

Sprachassistenten lernen Gebärdensprache

Signs überbrückt die Kluft zwischen Alexa und Hörbehinderten: Das Smart Tool entwickelten Bundesjugend - der Verband junger Menschen mit Hörbehinderung und MRM/McCann gemeinsam.

Foto: MRM/McCann

Im Juni feiert die Munich Marketing Week inspirierende Ideen für morgen. Technologien, die sich nach Zukunft anhören, aber jetzt schon Realität sind, die Customer-Centricity leben oder im Voice-Marketing vorne mit dabei sind.

So wie das Smart Tool, das die Bundesjugend - der Verband junger Menschen mit Hörbehinderung und die Digitalagentur MRM/McCann entwickelt haben.

Signs ist der erste Gebärdensprachassistent für Sprachassistenten wie Amazon Alexa, Google Assistant oder Microsoft Cortana. Es erkennt und übersetzt Gebärdensprache in Echtzeit und sorgt im digitalen Zeitalter für Barrierefreiheit und Inklusion.

Sprachassistenten prägen zunehmend die Gerätebedienung - aber was, wenn man nicht sprechen oder hören kann? Signs legt den Grundstein dafür, dass die Sprachassistenten nun auch per Gebärdensprache zugänglich sind. Weltweit leben 466 Millionen Menschen mit Hörbehinderung. Ziel ist, dass Signs langfristig als allgemein zugängliche Software und auch für Smartphones zur Verfügung steht und weltweit neue Gebärden und Gebärdensprachen lernen kann, teil die Agentur MRM/McCann mit.

Digital, connected, inklusiv - darum geht es den Machern. "Das digitale Zeitalter birgt riesige Chancen für Inklusion. Aber es gibt auch zahlreiche Herausforderungen wie beispielweise bei Sprachassistenten für Menschen mit Hörbehinderung. Die Idee von Signs stellt einen wichtigen Schritt dar, uns alle an neuen Technologien teilhaben zu lassen", sagt Michelle Mohring, 1. Bundesjugendleiterin, Verband junger Menschen mit Hörbehinderung. Sie hat an der Entwicklung mitgewirkt.

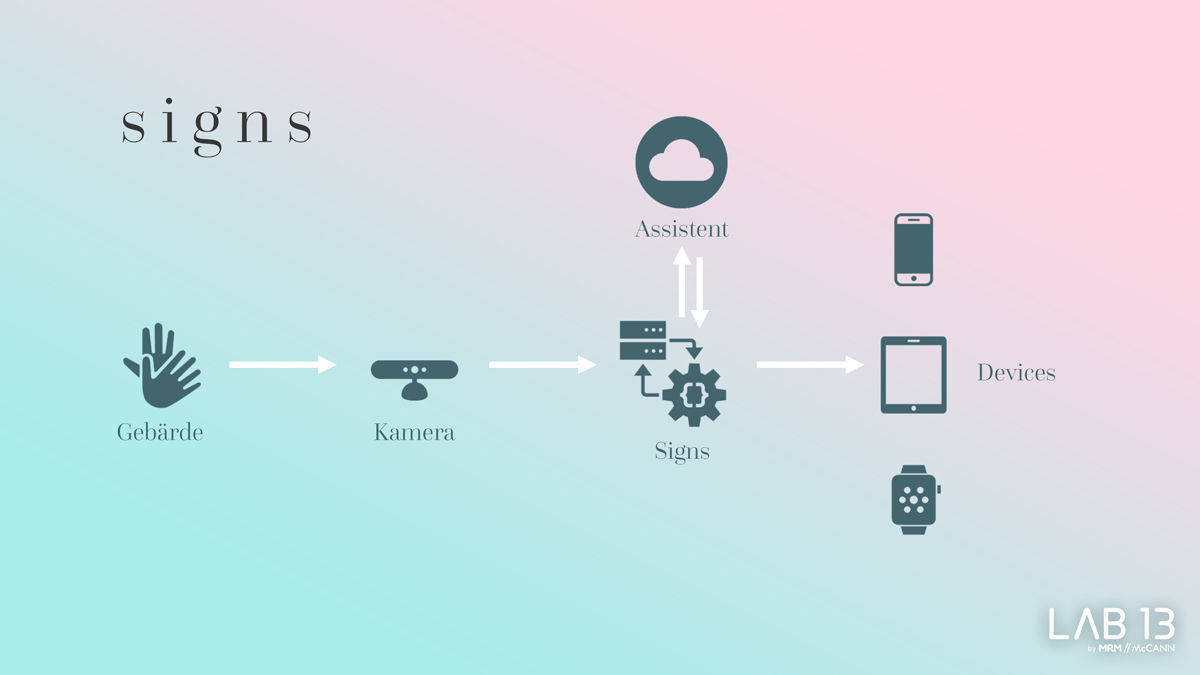

Das Smart Tool basiert auf einem Machine-Learning-Framework. Gebärden werden mit Hilfe einer integrierten Kamera identifiziert und in ein Data-Format konvertiert, das Sprachassistenten verstehen. Signs kann mit Alexa, Google Assistant oder Microsoft Cortana verbunden werden und funktioniert auf jedem browserbasierten Betriebssystem mit integrierter Kamera wie Laptops oder Tablets.

Die Sprachassistenten verarbeiten die Gebärdendaten in Echtzeit und können direkt antworten. Die Antworten übersetzt Signs zurück - in Textform oder visuelles Feedback für Menschen mit Hörbehinderung. Das Programm entstand in Zusammenarbeit des Lab 13, der interdisziplinären Innovation-Unit der Agentur MRM, mit der Bundesjugend.

Das Team von Lab 13 um Martin Biela, Executive Creative Director, und Mark Hollering, Director Creative Technology, griff die Idee auf, setzte sie in einem Prototypen um und entwickelte Signs in die Richtung eines vollumfänglichen Gebärdensprachassistenten.

In Deutschland sind nach Angaben des Deutschen Schwerhörigenbundes rund 140.000 der 16 Millionen Schwerhörigen auf Gebärdensprach-Dolmetscher angewiesen. Die Unternehmensberatung Gartner geht davon aus, dass digitale Interaktionen jenseits von Bildschirmen bis 2020 etwa 30 Prozent ausmachen werden. "Unser Ziel ist, dass jeder Mensch mit Hörbehinderung uneingeschränkt Zugang zu neuesten Technologien hat. Gerade jetzt, wo Sprachassistenten unsere Wohnungen, Autos und die Freizeitgestaltung erobern", sagt Martin Biela von MRM/McCann.

Credits: Chief Creative Officer MRM/McCann Frankfurt am Main Sebastian Hardieck, Executive Creative Director Martin Biela, Executive Creative Director Dushan Drakalski, Director Creative Technology & Lab 13 Mark Hollering, Group Creative Director UX Jan Portz, Senior Copywriter/Concept & Lab 13 Chris Endecott, IT Project Manager, Lab13 Sebastian Klein, Senior Motion Designer, Lab 13 Michael Klaiber, Senior Art Director Jawad Saleem, PR & Communications Jerome Cholet, Trainee Lab 13 Sofia Paz-Vivo, Junior Art Director Irini Sidira.